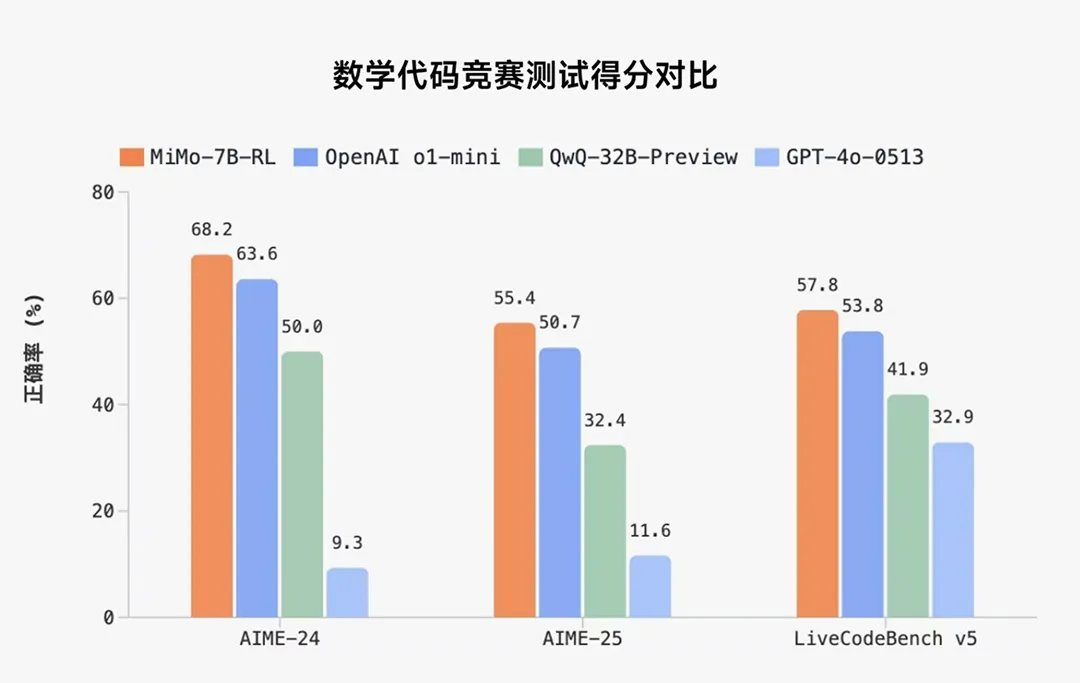

Home于4月30日报道说,现在通过官方的“小米Mimo”帐户宣布了大小米模型,这是小米的第一个大型模型“出生于推理”,小米启动其起源,并协调培训前和培训后的,全面的推理能力。据报道,MIMO是新成立的“小米大型模型核心团队”的初步尝试。 In the public review set of math reasoning (Aime 24-25) and Code Competition (LiveCodebench V5), MIMO has surpassed the closed-source inferrence model Openai Openai open-source inferrence model QWQ-32B-preview with 7B parameter size only.官员们说,提高MIMO识别能力的驱动是由许多级别的联合变化(例如数据和训练后训练阶段)的联合变化所驱动的,包括:培训前:核心是让模型观察到更多的不理解模式数据:专注于挖掘丰富的感兴趣和大约200B吊销数据供应200B吊销数据。练习:三个阶段进行培训以逐渐增加培训的困难,总培训为25T令牌。训练后:核心是增强和框架算法的良好且稳定的算法:测试难度是驱动的,提出了奖励,以减轻带有困难算法问题的稀疏问题,并引入简单的数据重新采样技术以稳定RL培训。框架:无缝控制系统旨在加速RL训练2.29次,并验证1.96次。它配备了开放地址资源:拥抱面:https://huggingface.co/xiaomimo技术报告:https://github.com/xiaomimimo/mimimo/mimo/blob/blob/mimo-mimo-7b-7b-poche

Home于4月30日报道说,现在通过官方的“小米Mimo”帐户宣布了大小米模型,这是小米的第一个大型模型“出生于推理”,小米启动其起源,并协调培训前和培训后的,全面的推理能力。据报道,MIMO是新成立的“小米大型模型核心团队”的初步尝试。 In the public review set of math reasoning (Aime 24-25) and Code Competition (LiveCodebench V5), MIMO has surpassed the closed-source inferrence model Openai Openai open-source inferrence model QWQ-32B-preview with 7B parameter size only.官员们说,提高MIMO识别能力的驱动是由许多级别的联合变化(例如数据和训练后训练阶段)的联合变化所驱动的,包括:培训前:核心是让模型观察到更多的不理解模式数据:专注于挖掘丰富的感兴趣和大约200B吊销数据供应200B吊销数据。练习:三个阶段进行培训以逐渐增加培训的困难,总培训为25T令牌。训练后:核心是增强和框架算法的良好且稳定的算法:测试难度是驱动的,提出了奖励,以减轻带有困难算法问题的稀疏问题,并引入简单的数据重新采样技术以稳定RL培训。框架:无缝控制系统旨在加速RL训练2.29次,并验证1.96次。它配备了开放地址资源:拥抱面:https://huggingface.co/xiaomimo技术报告:https://github.com/xiaomimimo/mimimo/mimo/blob/blob/mimo-mimo-7b-7b-poche

bat365在线平台官网_beat365体育官网

客服热线:400-123-4567

邮箱:admin@baidu.com

地址:广东省广州市天河区88号